云原生技术社区:Kubernetes、容器、DevOps与AI基础设施实践

云原生技术社区聚合 Kubernetes、容器、DevOps、微服务、平台工程、云原生安全和 AI 基础设施等实践内容,帮助开发者、运维团队和平台团队系统理解云原生架构、落地路径和生产环境治理方法。

文章精选

-

K8s集群规划怎么做?容器节点池与高可用设计

准备建设生产 K8s 集群时,最容易低估的是节点池、可用区和容量冗余之间的关系。本篇用规划问题和检查清单拆解 K8s集群设计路径,让集群从第一天就具备扩展余量、隔离边界和高可用基线。

-

分布式集群架构:控制面与数据面拆分

初看分布式集群架构,很容易把控制面、数据面和节点数量混为一谈。本文用云原生视角拆开职责、协作路径和边界对比,让架构概念能映射到真实 Kubernetes 平台。

-

内部开发者平台建设:能力地图与落地顺序

准备建设 IDP 时,很多团队会先做门户或工具集成,却忽略能力边界和组织责任。本篇用能力地图、阶段路线和协作边界,帮助你把内部开发者平台建设拆成可推进的行动顺序。

-

IDP选型怎么做?内部开发平台评估路径

做 IDP选型决策时,功能演示往往比真实落地更容易通过。本篇把选型问题改写成决策树、评估矩阵和 PoC 证据链,帮助平台团队判断哪条内部开发平台路线更适合当前阶段。

最新发布

-

K8s中GPU共享怎么选?MIG与时间片选择框架

一张GPU卡到底该切成固定实例,还是让多个任务轮流使用?围绕K8s GPU共享,本篇从隔离、显存、性能抖动和租户体验拆解MIG与时间片的取舍,并给出上线前检查清单。

-

GPU资源碎片化治理:画像、配额与调度策略

GPU利用率看似不低,任务却仍在队列里等待,往往不是单点扩容能解决的问题。本篇从GPU资源碎片化治理出发,拆解画像、配额、队列和调度策略如何协同,让剩余算力更容易被真正使用。

-

PVC扩容失败怎么办?检查容器存储、StorageClass与CSI

改了PVC容量却迟迟不生效时,先别急着删卷或重启业务。本篇按事件、StorageClass、CSI、PV/PVC、节点文件系统和应用视角拆解PVC扩容失败,帮助你判断请求卡在哪一段,以及下一步该低风险处理什么。

-

K8s调度插件原理:Filter、Score到Bind

Pod Pending不一定是CPU或内存不够,很多问题藏在调度插件的过滤、打分、预留和绑定阶段。本篇用Filter、Score到Bind的链路解释kube-scheduler如何做决策,并给出排查事件、日志和配置的对应视角。

-

K8s网络策略灰度上线与Pod访问控制回滚清单

准备把NetworkPolicy从测试环境推到生产时,最怕默认拒绝把正常调用、DNS解析或健康检查一起拦掉。本篇按依赖盘点、标签校验、灰度批次、观测指标和回滚条件拆解K8s网络策略上线清单,便于平台与业务团队共同验收。

-

vLLM Kubernetes部署怎么做?配置GPU推理服务

想把 vLLM 从单机示例放到 Kubernetes 上运行,难点通常不在启动命令,而在 GPU、模型文件、服务访问和运行状态验证。这篇文章按部署链路拆解可参考的配置思路。

-

LLMOps Kubernetes模型交付链路设计

大模型上线不是把容器部署到集群就结束。围绕 LLMOps和Kubernetes 的分工,本文梳理模型从注册、发布、扩缩容到观测回滚的交付链路,让平台团队看清先补哪一段能力。

-

KubeRay部署Ray集群的GPU调度步骤

想用 KubeRay 在 Kubernetes 上跑 Ray 集群,不能只看 RayCluster 是否创建成功。本文从 Head/Worker、GPU申请、训练任务提交和状态验证入手,梳理平台团队可落地的部署步骤。

-

KServe vLLM区别怎么判断?服务层对比方法

纠结 KServe 和 vLLM 怎么选时,先别急着做二选一。一个更偏模型服务层,一个更偏推理执行层;读完本文可以用层级、职责和场景矩阵判断它们在平台中的位置。

-

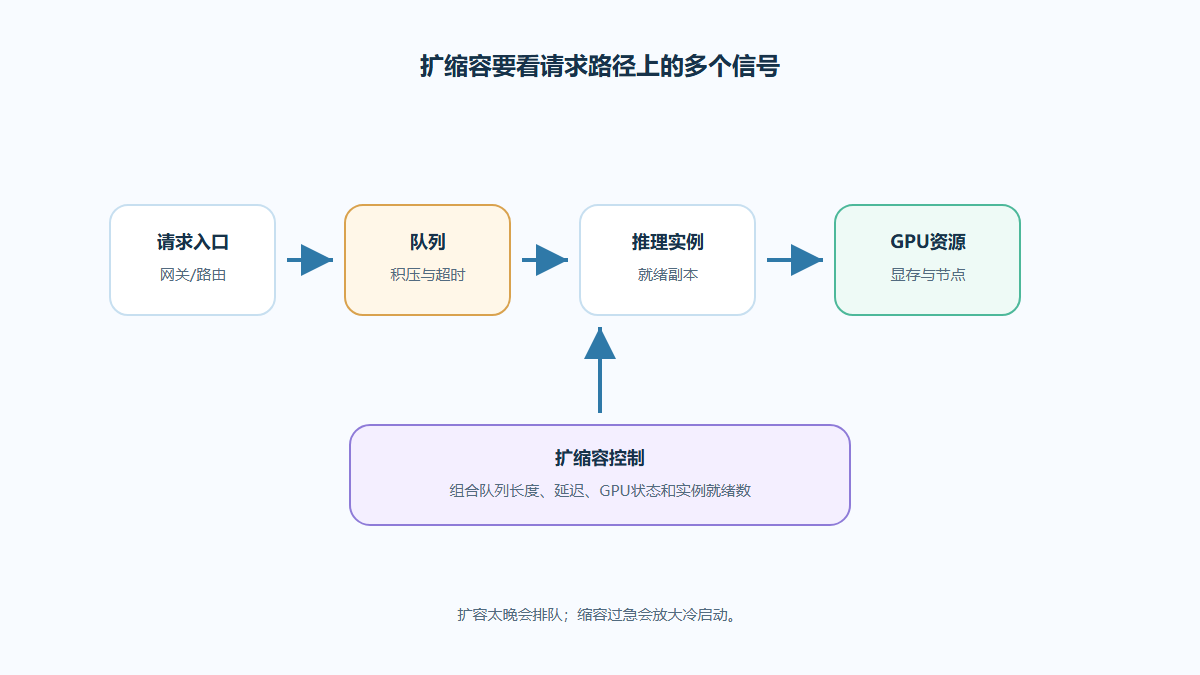

K8s模型推理扩缩容:HPA、队列、冷启动

推理服务明明开了 HPA,却还是排队、冷启动或 GPU 利用率异常?这篇内容把 CPU、队列、显存和模型加载放在同一条链路里看,给出 K8s模型推理扩缩容的判断框架和落地边界。

-

K8s GPU Operator部署-3步验证节点

集群已经有 GPU 节点,却不知道 Operator 是否真正生效?这篇内容从驱动、Device Plugin、节点标签和 Pod 调度结果入手,给出可复用的 K8s GPU Operator 验证路径。

-

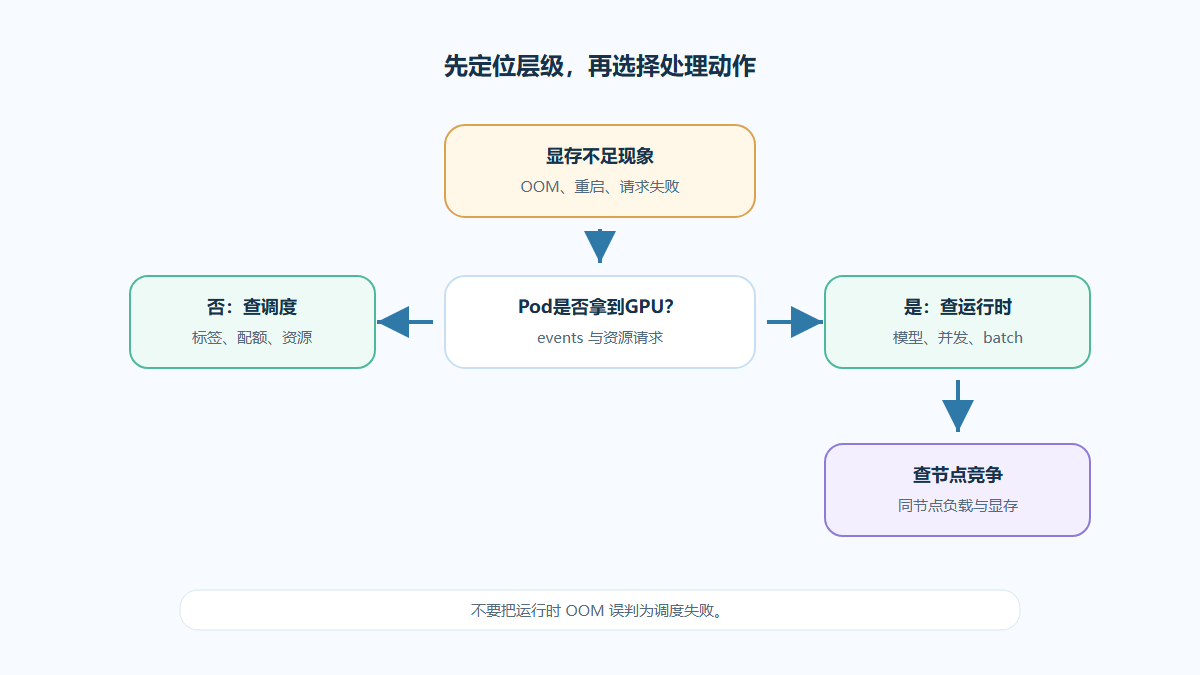

GPU显存不足怎么排查?定位Pod与模型配置

遇到 CUDA out of memory、Pod 重启或推理请求失败时,先别急着加卡或降级模型。本文用 K8s 视角串起事件、日志、资源请求、batch size 和显存预算,帮助定位真正瓶颈。

-

AI平台多租户配额怎么设计?设计租户和队列边界

当多个团队共用同一批 GPU 和模型环境时,AI平台多租户配额的难点常常不是资源本身,而是租户、队列、权限和借用规则没有说清。读完可获得一套可落地的治理检查路径。

-

容器部署和虚拟机部署的区别-5个判断维度

容器部署和虚拟机部署的区别,不只是启动速度和资源开销。本篇用5个判断维度拆解隔离层、交付链路和治理边界,说明哪些场景可先试点容器、哪些场景应继续保持虚拟机,并形成更稳妥的部署组合。

-

容器部署和传统部署哪个好?选型判断框架

容器部署和传统部署哪个好,取决于应用形态、发布频率和运维成熟度。本篇用条件化结论、对比表和迁移路径,帮助你判断哪些应用适合先容器化、哪些仍可继续传统部署,并规划渐进改造顺序。

-

容器部署方式的优点与企业交付收益

想判断容器部署方式的优点,不能只看启动速度。本篇从交付一致性、弹性扩展、环境隔离和运维自动化切入,帮你区分可直接获得的收益、需要平台流程支撑的收益,以及落地前应避开的误区。

-

TKE容器迁移评估:治理边界与验证路径

已有 TKE 或托管 Kubernetes 集群需要迁移时,最难的通常不是 YAML 能否重放,而是治理边界能否接住。本文用迁移评估清单拆解资源、权限、网络、存储和发布验证,避免把平台化改造写成厂商对比。

-

容器平台高可用容灾怎么做?验证恢复路径

高可用不等于容灾,备份成功也不代表恢复可靠。面向生产平台团队,本文把故障域拆分、切换路径、数据恢复、验证指标和复盘证据串起来,帮助你设计一次可证明的容器平台容灾演练。

-

裸金属K8s平台规划资源池运维边界

IDC 或私有化环境里的裸金属节点一多,问题往往从部署变成资源池治理。本文用平台团队视角拆解资源分层、节点纳管、运维边界和上线检查,帮助你判断裸金属容器平台该怎么规划。

-

多集群架构一体化如何落地治理边界

多集群架构一体化真正难管的往往不是接入动作,而是谁能操作、策略如何下发、故障如何隔离。本篇从治理边界切入,梳理一体化架构的分层、风险和落地顺序,帮助平台团队先把边界讲清楚。